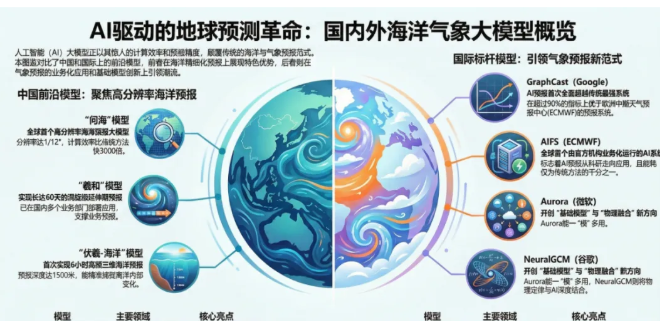

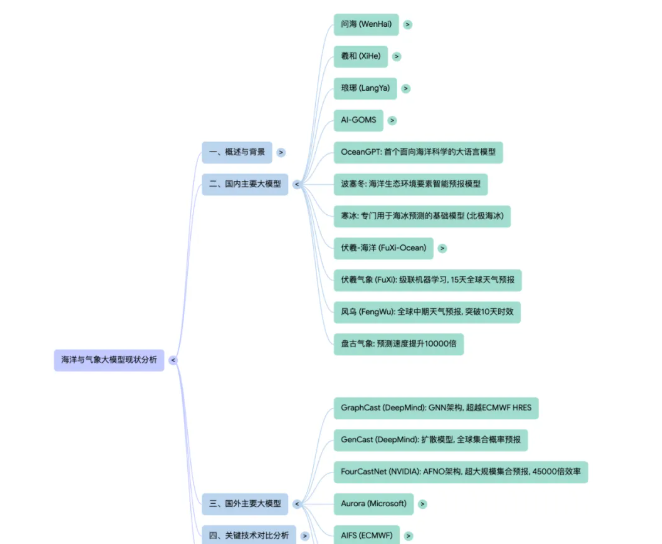

气象海洋大模型对比分析

随着人工智能技术的快速发展,大模型技术正在深刻改变海洋科学研究和海洋环境预报的范式。传统的海洋数值预报模式虽然基于严格的物理方程,但计算成本高昂、时效性受限。近年来,国内外科研机构和企业积极探索将深度学习技术应用于海洋环境预报领域,涌现出一批具有代表性的海洋大模型。

本文系统梳理了当前国内外主要的海洋大模型及相关气象大模型的发展现状,包括国内的问海、羲和、琅琊、AI-GOMS、OceanGPT、波塞冬、FUXI-Ocean等海洋专用大模型,以及伏羲、风乌、盘古等气象大模型;国外的GraphCast、GenCast、FourCastNet、Aurora、AIFS、NeuralGCM等气象大模型,以及Samudra等海洋大模型。报告从研发机构、技术特点、预报要素、预报能力、计算效率等多个维度进行分析对比,为海洋人工智能领域的研究和应用提供参考。

二、国内海洋与气象预报大模型

2.1 问海大模型(WenHai)

2.1.1 基本信息

问海大模型是全球首个高分辨率(1/12°)海洋环境智能预报大模型,由崂山国家实验室、中国海洋大学、中国科学技术大学联合研发。该模型于2024年5月27日作为“瀚海星云”大模型应用体系的领域大模型同步发布,相关论文发表于Nature Communications期刊。

2.1.2 技术特点

- • 将块体公式(Bulk Formula)显式嵌入神经网络,准确表征海-气间的动量、热量和物质交换过程

- • 利用海陆分布掩码(Ocean-Land Mask),赋予模型对地形岸界的感知能力

- • 以海洋状态的变化趋势作为预报目标,而非直接预报海洋状态本身

- • 采用微调技术改善迭代预报过程中的累积误差问题

- • 采用“近邻”评估(Neighbourhood Evaluation)方案,评估连续排名概率得分(CRPS)

2.1.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 1/12°(约9公里) |

| 时间分辨率 | 逐日预报 |

| 预报时效 | 10天 |

| 预报要素 | 海表面温度(SST)、海表面高度(SSH)、海表面盐度(SSS)、海表面流场(UV) |

| 训练数据 | GLORYS12海洋再分析数据(1993-2022年)和ERA5大气再分析数据 |

| 计算效率 | 相较传统数值预报提升3000倍 |

2.2 羲和海洋大模型(XiHe)

2.2.1 基本信息

羲和大模型由国防科技大学研发。该模型是全球首个数据驱动的海洋涡旋分辨智能预报大模型,同样基于GLORYS12数据训练,支持全球高精度海洋预报。模型已在多个机构部署运行,为业务预报提供数据支撑。

2.2.2 技术特点

- • 采用Swin-Transformer架构,有效处理高分辨率全球海洋数据

- • 利用Ocean-Land Mask排除陆地干扰,专注海洋动力过程学习

- • 预报变量包括海温、盐度、流速、海面高度以及混合层深度

- • 支持1-60天的延伸期预报能力

2.2.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 1/12°(约9公里),可分辨100公里中尺度涡旋 |

| 预报时效 | 短期10天,延伸期可达60天 |

| 预报要素 | 海表温度、盐度、流速、海面高度、混合层深度 |

| 计算效率 | 比传统数值模式快1000倍以上 |

| 应用部署 | 已在自然资源部、中国气象局、高校等机构部署运行 |

2.3 琅琊海洋大模型(LangYa)

2.3.1 基本信息

琅琊海洋大模型由中国科学院海洋研究所研发,于2024年8月正式发布1.0版本。该模型聚焦西北太平洋和中国近海区域,是面向海洋科学研究和预报业务的领域专用大模型。

2.3.2 技术特点

- • 融合AI技术与传统海洋学知识,构建知识增强的预报模型

- • 聚焦西北太平洋和中国近海区域,提供高精度区域预报

- • 支持海洋物理场、生态场多要素智能预报

2.3.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 1/12° |

| 预报时效 | 7天 |

| 主要区域 | 西北太平洋、中国近海 |

| 版本状态 | 1.0版本已发布 |

2.4 AI-GOMS全球海洋建模系统

2.4.1 基本信息

AI-GOMS(AI-driven Global Ocean Modeling System)是由清华大学和华为云联合开发的全球海洋智能建模系统。该系统在30天海洋预报任务中,多数指标上超越了传统海洋数值模式FOAM和业界AI预报模型GraphCast,实现了多个技术突破。

2.4.2 技术特点

- • 采用Fourier MAE(傅里叶掩码自编码器)架构,在频域空间进行特征学习

- • 创新的多尺度特征融合机制,有效捕捉不同时空尺度的海洋动力过程

- • 支持全球尺度的长时间序列预报

2.4.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 1/4°(约25公里) |

| 预报时效 | 30天 |

| 预报要素 | 海表温度、盐度、流场等 |

| 性能对比 | 多数指标超越FOAM和GraphCast |

2.5 OceanGPT海洋科学大语言模型

2.5.1 基本信息

OceanGPT是由浙江大学开发的首个面向海洋科学任务的大语言模型,专注于海洋科学知识问答和文本理解任务。该模型基于LLaMA架构开发,已开源发布并被ACL 2024会议收录。

2.5.2 技术特点

- • 基于DoInstruct框架,有效解决海洋领域数据稀缺问题

- • 专门针对海洋科学知识问答进行优化

- • 支持多种海洋科学文本理解任务

2.6 波塞冬海洋生态环境大模型(Poseidon)

2.6.1 基本信息

波塞冬(Poseidon)是由浙江大学地球科学学院研发的海洋生态环境要素智能预报大模型。

2.6.2 技术特点

- • 针对海洋生态环境的遥感大数据智能预报问题

- • 创新性利用大模型解决海洋遥感预报难题

- • 采用多源海洋数据作为输入

- • 构建基于人工智能和大数据技术的预报模型

2.6.3 模型能力

| 指标 | 详情 |

| 预报要素 | 海洋生态环境要素 |

| 数据来源 | 多源海洋遥感数据 |

| 发布时间 | 2024年11月 |

2.7 伏羲海洋大模型(FuXi-Ocean)

2.7.1 基本信息

FuXi-Ocean是首个实现6小时时间分辨率的数据驱动全球海洋预报模型,由复旦大学研发。该模型于2025年发表于机器学习顶级会议NeurIPS,是海洋AI预报领域的重要突破。

2.7.2 技术特点

- • 首次实现6小时时间分辨率的海洋预报,覆盖深度可达1500米(20个深度层)

- • 创新性提出Mixture-of-Time(MoT)模块,自适应集成多时间窗口预测,针对不同海洋变量学习特定时间依赖性

- • 采用上下文感知特征提取模块结合堆叠注意力块的预测网络架构

- • 数据高效:仅使用约9年训练数据(2006-2015年HYCOM再分析数据)即达到SOTA性能

- • 仅依赖纯海洋变量作为输入(温度、盐度、U/V流速、SSH),无需大气强迫数据

2.7.3 预报能力

| 指标 | 能力描述 |

| 预报要素 | 温度、盐度、U/V流速、海表高度(SSH) |

| 预报时效 | 10天(每6小时输出一次预报) |

| 空间分辨率 | 1/12°(约9公里),具备涡旋分辨能力 |

| 时间分辨率 | 6小时(首个实现次日内高频预报的AI海洋模型) |

| 垂直覆盖 | 0-1500米,20个深度层 |

| 计算效率 | 4张H100 GPU训练约81小时,推理速度远超传统数值模式 |

| 性能表现 | 在IV-TT评估框架下,SST预报优于HYCOM、BLK、FOAM等业务系统,累积误差增长明显更小 |

2.8 伏羲气象大模型(FuXi)

伏羲是由复旦大学研发的级联机器学习预报系统,相关论文发表于npj Climate and Atmospheric Science。该模型支持15天全球天气预报,是国内首个发表的此类系统。

| 指标 | 详情 |

| 空间分辨率 | 0.25° |

| 预报时效 | 15天(采用级联策略:0-5天、5-10天、10-15天) |

| 核心技术 | Transformer架构 + Mixture of Experts |

| 训练数据 | ERA5再分析数据(1979-2015年) |

| 性能表现 | 3-15天预报超越GraphCast |

2.9 风乌气象大模型(FengWu)

风乌是由上海人工智能实验室开发的全球中期天气预报大模型,相关论文于2023年发布。该模型目标是突破10天以上预报时效的技术瓶颈,提供更长时效的精准预报。

| 指标 | 详情 |

| 空间分辨率 | 0.25° |

| 预报时效 | 10.75天(业界领先) |

| 预报要素 | 高度场、风场、温度、湿度、海平面气压等 |

| 计算效率 | 单GPU 30秒完成10天预报,超过传统方法2000倍以上 |

| 性能表现 | 80%评估指标超越DeepMind的GraphCast,10天预报误差降低10.87% |

2.10 盘古气象大模型(Pangu-Weather)

2.10.1 基本信息

盘古气象大模型(Pangu-Weather)是全球首个精度超过传统数值预报方法的AI气象预测模型,由华为云开发。该研究成果于2023年7月以正刊形式发表于国际顶级学术期刊《Nature》,被认为是人工智能在气象领域应用的重要里程碑,改变了传统气象预报单纯依赖数值计算的范式。

2.10.2 技术特点

- • 3D Transformer架构:创新性提出3D Earth-Specific Transformer (3DEST) 架构,将三维气象数据处理为三维立方体(Cuboid),相比传统2D模型能更有效地捕捉大气数据的三维空间相关性。

- • 层次化时域聚合策略:针对迭代预测中的误差累积问题,训练了1小时、3小时、6小时和24小时等不同预测间隔的模型,通过贪心算法减少长时效预报的累积误差。

- • 高分辨率建模:实现了0.25°(约28公里)的全球高分辨率气象预报,分辨率水平与欧洲中期天气预报中心(ECMWF)的IFS系统一致。

- • 极致推理速度:相比传统数值预报方法(NWP),推理速度提升10,000倍以上,极大降低了计算能耗。

- • 海量数据驱动:基于ECMWF的ERA5再分析数据(1979-2017年)进行训练,利用43年的全球历史气象数据学习大气演变规律。

2.10.3 预报能力

| 指标 | 能力描述 |

| 预报要素 | 涵盖13个高空层(位势、比湿、温度、U/V风速)及地表变量(海平面气压、10米风速、2米温度等) |

| 预报时效 | 中期天气预报(支持7天以上),具备秒级生成全球预报能力 |

| 空间分辨率 | 0.25° × 0.25°(赤道处约28公里) |

| 时间分辨率 | 1小时(支持逐小时高频滚动预报) |

| 垂直覆盖 | 1000hPa至50hPa,共13个主要气压层 |

| 计算效率 | 单张V100 GPU仅需1.4秒即可完成24小时全球预报,速度远超传统数值模式 |

| 性能表现 | 在Z500、T850等关键气象指标的确定性预报精度上,全面超越ECMWF的IFS系统(世界顶级数值模式);在台风路径追踪等极端天气场景下表现出极高的准确性 |

三、国外气象与海洋大模型

3.1 GraphCast气象预报模型

3.1.1 基本信息

GraphCast是由Google DeepMind开发的全球气象预报大模型,于2023年11月在Science期刊发表。该模型是首个在全球中期天气预报中超越ECMWF业务系统(HRES)的机器学习模型,代表了AI气象预报领域的里程碑式进展。模型代码已在GitHub开源。

3.1.2 技术特点

- • 采用图神经网络(GNN)架构,基于多尺度网格表示全球大气状态

- • 使用编码器-处理器-解码器范式,有效捕捉大气变量间的空间依赖关系

- • 基于ECMWF ERA5再分析数据(1979-2017年)进行训练

- • 采用自回归方式进行多步预报,每6小时输出一次预报结果

3.1.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 0.25°(约25公里) |

| 时间分辨率 | 6小时 |

| 预报时效 | 10天 |

| 预报变量 | 227个关键大气变量,37个气压层 |

| 计算效率 | 单GPU不到1分钟生成10天预报,比HRES快1000倍以上 |

| 性能表现 | 在90%以上的评估指标上超越ECMWF HRES |

3.2 GenCast集合预报模型

3.2.1 基本信息

GenCast是Google DeepMind于2024年发布的基于扩散模型的全球集合天气预报系统。该模型在Nature期刊发表,是首个在集合预报任务中全面超越ECMWF集合预报系统(ENS)的机器学习模型。GenCast代表了从确定性预报向概率预报的重要转变。

3.2.2 技术特点

- • 采用扩散模型架构,从噪声中迭代生成大气状态

- • 适应地球球面几何特征,使用二十面体网格表示

- • 生成50个或更多集合成员,提供完整的概率预报

- • 支持极端天气事件和热带气旋路径预报

3.2.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 0.25° |

| 时间分辨率 | 12小时 |

| 预报时效 | 15天 |

| 预报变量 | 80多个地表和大气变量 |

| 计算效率 | 8分钟生成完整15天集合预报 |

| 性能表现 | 在97.2%的评估指标上超越ECMWF ENS |

3.3 FourCastNet气象预报模型

3.3.1 基本信息

FourCastNet(Fourier ForeCasting Neural Network)是NVIDIA开发的全球气象预报模型,是NVIDIA Earth-2平台的核心组件。最新版本FourCastNet 3于2025年发布,在概率预报、计算效率、频谱保真度等方面实现了重大突破。模型已在NOAA等机构部署运行。

3.3.2 技术特点

- • 采用自适应傅里叶神经算子(AFNO)架构,在频域空间进行特征学习

- • 支持超大规模集合预报,可生成数千个集合成员

- • 针对球面几何特征优化的卷积神经网络架构

- • 在亚季节至季节(S2S)时间尺度上保持稳定

3.3.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 0.25° |

| 时间分辨率 | 6小时 |

| 预报时效 | 中期10天,延伸期可达60天 |

| 计算效率 | 单GPU 4分钟完成60天预报,比传统方法快45000倍 |

| 能耗效率 | 能耗仅为传统数值模式的万分之一 |

| 性能表现 | 中期预报技巧与GenCast相当,超越IFS-ENS |

3.4 Aurora地球系统基础模型

3.4.1 基本信息

Aurora是微软研究院开发的首个大规模地球系统基础模型(Foundation Model),于2024年发表于Nature期刊。该模型采用基础模型方法,在超过100万小时的多样化地球物理数据上进行预训练,可通过微调适应多种预报任务。模型代码和权重已完全开源。

3.4.2 技术特点

- • 采用3D Swin Transformer架构,配合3D Perceiver编解码器

- • 13亿参数的大规模模型,支持多分辨率、多变量输入

- • 采用LoRA技术进行高效微调,适应下游任务

- • 支持天气预报、空气质量、海浪、热带气旋等多种预报任务

3.4.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 高分辨率版本0.1°(约11公里) |

| 预报时效 | 天气10天,空气质量5天 |

| 预报任务 | 天气、空气质量、海浪、热带气旋路径 |

| 训练数据 | ERA5、CMIP6、HRES、GFS等100万小时数据 |

| 计算效率 | 比传统方法快约5000倍 |

| 性能表现 | 在91%的评估指标上超越同类模型 |

3.5 AIFS人工智能预报系统

3.5.1 基本信息

AIFS(Artificial Intelligence Forecasting System)是欧洲中期天气预报中心(ECMWF)自主研发的人工智能预报系统,于2025年2月正式投入业务运行。这是全球首个由国际气象机构正式业务化运行的AI气象预报系统,标志着AI预报从研究走向业务应用的重要里程碑。2025年7月,AIFS集合预报版本(AIFS ENS)也投入运行。

3.5.2 技术特点

- • 采用图神经网络编解码器和滑动窗口Transformer处理器架构

- • 与IFS共享初始场,每6小时运行一次

- • 基于Anemoi开源框架开发,支持多种并行训练策略

- • 提供最广泛的预报变量,包括降水类型等

3.5.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 当前约31公里(目标提升至9公里) |

| 预报时效 | 10天 |

| 集合成员 | AIFS ENS提供51个集合成员 |

| 运行状态 | 已正式业务运行,提供24/7支持 |

| 计算效率 | 能耗仅为传统方法的千分之一 |

| 性能表现 | 热带气旋路径预报提升20% |

3.6 NeuralGCM混合气候模型

3.6.1 基本信息

NeuralGCM是Google Research与ECMWF合作开发的混合气候模型,于2024年发表于Nature期刊。该模型创新性地将可微分的物理动力学求解器与机器学习组件相结合,既保持了物理模型的可解释性,又获得了机器学习的效率优势,是物理驱动与数据驱动融合的典范。

3.6.2 技术特点

- • 将可微分动力学核心与神经网络物理参数化相结合

- • 端到端训练,同时优化物理和学习组件

- • 支持确定性预报和集合概率预报

- • 可准确模拟热带气旋等涌现现象

3.6.3 模型能力

| 指标 | 详情 |

| 空间分辨率 | 0.7°至2.8°(约78-310公里) |

| 预报时效 | 天气1-15天,气候数十年 |

| 训练数据 | ECMWF 1979-2019年数据 |

| 计算效率 | 比传统GCM快3500倍,成本降低10万倍 |

| 气候模拟 | 40年温度预测误差仅为传统模型的1/3 |

| 性能表现 | 1-10天预报与GraphCast相当,15天集合预报与ECMWF ENS相当 |

四、技术对比分析

4.1 国内主要海洋大模型对比

| 模型 | 研发机构 | 分辨率 | 预报时效 | 核心技术 | 应用状态 |

| 问海 | 崂山实验室等 | 1/12° | 10天 | Bulk Formula嵌入 | 已发布 |

| 羲和 | 国防科大等 | 1/12° | 10-60天 | Swin-Transformer | 已部署 |

| 琅琊 | 中科院海洋所 | 1/12° | 7天 | AI+海洋知识融合 | 1.0版本 |

| AI-GOMS | 清华/华为 | 1/4° | 30天 | Fourier MAE | 论文阶段 |

| OceanGPT | 浙江大学 | - | - | DoInstruct框架 | 已开源 |

| 波塞冬 | 浙江大学 | - | - | 遥感大数据+AI | 获奖项目 |

4.2 国外主要气象/海洋大模型对比

| 模型 | 研发机构 | 分辨率 | 预报时效 | 核心技术 | 应用状态 |

| GraphCast | Google DeepMind | 0.25° | 10天 | 图神经网络GNN | 已开源 |

| GenCast | Google DeepMind | 0.25° | 15天 | 扩散模型集合预报 | 已开源 |

| FourCastNet | NVIDIA | 0.25° | 10-60天 | 傅里叶神经算子 | Earth-2平台 |

| Aurora | 微软研究院 | 0.1° | 10天 | 3D Swin Transformer | 已开源 |

| AIFS | ECMWF | ~31km | 10天 | GNN+Transformer | 业务运行 |

| NeuralGCM | Google Research | 0.7-2.8° | 15天+气候 | 物理+ML混合 | 已开源 |

4.3 关键技术特征分析

4.3.1 模型架构

当前海洋和气象大模型主要采用以下几类架构:

(1)图神经网络(GNN):GraphCast、AIFS采用GNN处理球面数据的空间依赖关系;(2)Transformer及变体:羲和采用Swin-Transformer,Aurora采用3D Swin Transformer;

(3)傅里叶神经算子:FourCastNet、AI-GOMS在频域空间进行特征学习;

(4)扩散模型:GenCast采用扩散模型生成集合预报;

(5)混合架构:NeuralGCM创新性地将可微分物理求解器与神经网络相结合。

4.3.2 物理约束融合

物理约束融合是提升模型可靠性的关键技术。国内的问海模型将Bulk Formula显式嵌入神经网络,羲和和问海均采用Ocean-Land Mask处理海陆边界。国外的NeuralGCM则代表了物理-数据融合的最前沿,将可微分动力学核心与机器学习参数化相结合,既保持了物理可解释性,又获得了数据驱动的效率优势。

4.3.3 计算效率对比

AI大模型在计算效率上实现了数量级的提升。国内模型:问海快3000倍,羲和快1000倍,风乌快2000倍;国外模型:GraphCast快1000倍,FourCastNet快45000倍,NeuralGCM快3500倍且成本降低10万倍。特别值得注意的是,AIFS能耗仅为传统方法的千分之一,为绿色计算树立了标杆。这些效率提升使得实时预报、集合预报和长期气候模拟成为可能。

五、发展趋势与展望

5.1 技术发展趋势

- • 基础模型范式:从任务专用模型向通用基础模型发展,如Aurora等支持多任务微调

- • 物理-数据融合:NeuralGCM等混合架构代表了物理约束与数据驱动深度融合的方向

- • 集合概率预报:从确定性预报向集合概率预报转变,GenCast等模型引领这一趋势

- • 多圈层耦合:从单一大气/海洋预报向海-气-冰-生多圈层耦合预报发展

- • 业务化应用:AIFS的业务运行标志着AI预报从研究走向实际应用

5.2 国内外发展对比

国外在气象AI大模型领域起步较早,Google DeepMind、NVIDIA、微软、ECMWF等形成了完整的技术生态。ECMWF的AIFS已实现业务运行,代表了AI预报的最高应用水平。国内在海洋AI大模型领域具有特色优势,问海、羲和等模型在海洋涡旋分辨预报方面达到国际领先水平。未来,加强国际合作、推动开源共享、加快业务化应用将是重点发展方向。

5.3 面临的挑战

- • 数据质量:高质量海洋观测数据稀缺,尤其是深海和极地区域

- • 模型可解释性:深度学习模型的'黑箱'特性限制了在业务预报中的应用

- • 极端事件预报:对海洋热浪、风暴潮等极端事件的预报能力仍需提升

- • 气候外推能力:当前模型难以外推至显著不同的未来气候状态

- • 业务化转型:从科研模型到业务系统的转化仍需大量工程化工作

5.4 发展建议

- • 加强海洋观测系统建设,为大模型训练提供高质量数据支撑

- • 借鉴NeuralGCM等混合架构经验,发展可解释的海洋大模型

- • 建立统一的海洋大模型评估标准和基准测试集

- • 参考ECMWF的AIFS经验,加快推动国内模型的业务化应用

- • 加强国际合作和开源共享,融入全球AI预报技术生态

本文内容仅供参考,不构成任何专业建议。使用本文提供的信息时,请自行判断并承担相应风险。