程序化 SEO 规模化常见坑有哪些?如何避免内容重复与排名崩盘?

程序化 SEO 一旦跨过几千个 URL,就不再是 “批量生成页面” 那么简单了。到了这个体量,SEO 变成了系统工程——内容、元数据、内链、站点地图、渲染策略,环环相扣。否则,你收获的只会是一堆被索引却永远上不了排名的垃圾页面。

本文拆解一套生产级的程序化 SEO 架构,让你在 Next.js 中扩展到十万级页面,同时不浪费爬取预算,不牺牲内容质量,也不拖垮构建性能。

大多数程序化 SEO 在规模化时翻车

大部分团队的程序化 SEO 起手式是这样的:

· 根据关键词批量生成几千个页面

· 用同一套模板,换点文字了事

· 丢一个巨型站点地图出去

· 然后祈祷谷歌自己能搞明白

这套路能撑一阵子,但迟早会崩。

常见的翻车姿势:

· 内容太薄或大量重复,直接被无视

· 关键词自相残杀,排名全军覆没

· 静态构建超时爆炸

· 内链几乎为零

· 站点地图大到没法维护

· 元数据逻辑到处复制粘贴

一旦规模上去,SEO 需要的是架构设计,不是东拼西凑的权宜之计。

起跑线:扩展之前必须具备的基础

一个可扩展的程序化 SEO 系统,默认你已经有了这些:

· 集中式的站点配置

· 全局结构化数据实现

· 动态元数据支持

· 完善的缓存与安全头设置

这些是入场券。它们不会帮你扩展,但没有它们,扩展只会放大问题。

核心理念:把 SEO 关注点拆成独立系统

团队最常犯的错误,是把 SEO 逻辑直接揉进页面组件里。

正确的做法是分层思考:

1. 数据层决定哪些页面应该存在

2. SEO 核心层决定如何向搜索引擎描述页面

3. 模板层决定页面的呈现方式

4. 路由层决定页面如何生成

5. 链接层决定页面之间如何关联

这些模块一旦解耦,扩展就变得可预测。

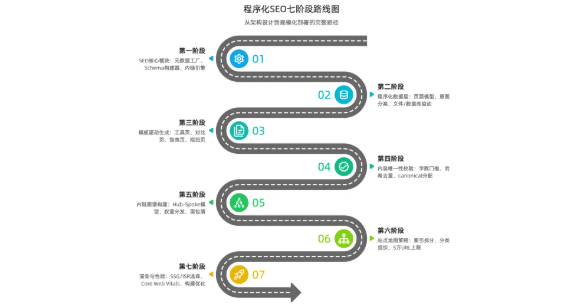

第一阶段:构建 SEO 核心模块

在生成任何新页面之前,先把 SEO 逻辑抽取到独立模块。

元数据工厂化

每个页面应该从生成器获取元数据,而不是手动定义。

这样做的好处:

· 标题格式统一

· 关键词注入安全可控

· canonical 强制执行

· OG 和 Twitter 卡片自动生成

元数据应该从内容派生,不能在组件里硬编码。

Schema 构建器:可组合,可复用

Schema 不应该在各个布局里复制粘贴。

按内容类型构建 Schema 生成器:

· Article (文章)

· FAQ (常见问题)

· Breadcrumb (面包屑)

· Product (产品)

· HowTo (教程)

每个页面只组合自己需要的部分。JSON-LD 保持精简、相关、可 tree-shake。

内链引擎:自动化驱动

内链应该自动化驱动,不能完全依赖人工编辑。

一个内链引擎应该能:

· 理解 Hub (枢纽页) 和 Spoke (分支页) 的关系

· 根据分类和搜索意图推荐相关页面

· 自动生成面包屑导航

· 在内容块中注入上下文相关链接

如果链接只存在于导航栏,你在浪费爬取预算。

第二阶段:程序化数据层

程序化 SEO 的成败,取决于数据模型。

每个页面都必须是一等公民,而不只是一个 URL slug。

一个完善的程序化页面模型应包含:

· 意图 (信息型、交易型、导航型)

· 主关键词

· 辅助关键词

· FAQ 列表

· 父级 Hub

· 相关页面

· Schema 类型

· 最后修改日期

有了这些,后续的校验、去重、智能链接才有据可依。

文件驱动 vs 数据库驱动

文件驱动的内容在 5 万页以内运行良好,简单直接。

当出现以下情况时,数据库驱动就成了刚需:

· 需要增量静态再生 (ISR)

· 页面更新频繁

· 内容由用户生成

· 页面数量超出构建时间承受范围

抽象是关键——页面不应该关心内容从哪里来。

第三阶段:模板驱动的页面生成

到了规模化阶段,每个页面都必须映射到一个模板。

举几个例子:

· 工具落地页

· 对比页

· 操作指南页

· 分类枢纽页

· 地域页

模板的作用是强制执行:

· 布局一致性

· 最低内容深度

· 自动化 SEO 组件

· 可预测的内链结构

如果两个页面的搜索意图相同,它们就应该共用一个模板。

第四阶段:内容唯一性校验

这是大多数程序化 SEO 悄无声息死掉的地方。

你需要硬性防线:

· 每页最低字数门槛

· FAQ 数量下限

· 内容哈希检测近似重复

· 相似变体分配 canonical

· 关键词重叠度检测

如果你都说不清两个页面为什么应该独立存在,谷歌也不会替你想明白。

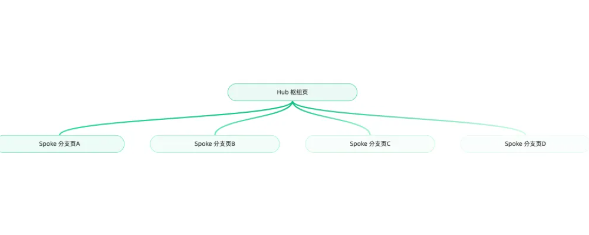

第五阶段:内链是一张图

用 Hub-and-Spoke 模型思考:

· Hub 瞄准宽泛的高层级查询

· Spoke 瞄准长尾变体

· Spoke 向上链接 Hub

· Hub 把权重向下分发

每个页面都应该能回答:

· 我的父级 Hub 是谁?

· 我的兄弟页面有哪些?

· 用户接下来应该读什么?

这样,成千上万的页面就构成了一张可爬取、有意义的图谱,而不是一堆孤岛 URL。

第六阶段:规模化的站点地图策略

单个站点地图扛不住规模。

正确做法:

· 使用站点地图索引

· 按分类拆分站点地图

· 每个文件不超过 5 万个 URL

· 填写准确的最后修改日期

站点地图应该反映内容结构,而不是简单地把 URL 倒进去。

第七阶段:渲染与性能决策

不是所有页面都配得上同一套渲染策略。

· 纯静态生成用于永不变化的内容

· ISR (增量静态再生) 用于程序化 SEO 内容

· 长周期 revalidation 用于对比页面

· 动态渲染只在万不得已时使用

规模化时过度使用 SSG 会拖垮构建;过度使用动态渲染会损害可爬取性。平衡是关键。

程序化 SEO 的真相

程序化 SEO 不是增长黑客,而是杠杆效应。

做对了:

· 一套系统生成数万有价值的页面

· 内容保持一致且可爬取

· SEO 效果随时间提升,而非衰退

做错了:

· 你发布的数千页面被谷歌视而不见

· 域名信任度被消耗殆尽-恢复所需的时间,比一开始就做对还要长

如果你认真对待程序化 SEO,就把它当作基础设施来建设,而不是内容灌水。

总结

扩展到十万级页面,靠的不是生成更多 URL。

靠的是:

· 系统优于脚本

· 校验优于数量

· 结构优于捷径

· 意图优于关键词

先把架构建好,内容随后跟上。顺序不能颠倒。

跳过地基,规模就会惩罚你。

本文内容仅供参考,不构成任何专业建议。使用本文提供的信息时,请自行判断并承担相应风险。